| New Products |

|

|

●新規価格 232,000円(SS:49,000円) |

●リリース 2016年 12月

シミュレーション |

|

|

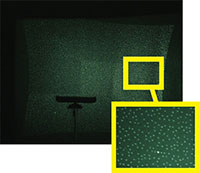

| KinectプラグインはDepthセンサーからのデータを使用します。対応するデバイスはKinectTM Sensor for Xbox、Xtion

Pro、Xtion Pro Liveです。この3つのセンサーはPrimeSenseの技術に基づいており、赤外線を使用してドット模様を投影し、赤外線カメラでそれを検知します。人の目では見えませんが(周波数は約780nm)、暗視機能のあるカメラでは捉えることができます(図1)。障害物がセンサーの検知エリアに入り込んだ場合は、レーザーの模様が乱れるため、センサーは撮影エリアのDepth

Mapを作成することができます。そして、Depth Mapを分析し、形状を判別することが可能です。より詳しい分析で、それぞれの形状を人の体の形と合わせ、人の骨格を判別できます。 |

|

▲図1 赤外線レーザー模様 |

|

KinectプラグインはUDPソケットを通して簡単な方法で、Depthセンサーのデータにアクセスできるインターフェースとして開発しました。Depth

Mapデータ(図2)と骨格追跡データ(骨の接合部の情報)の他に、両手の動きと位置の動作を検知し、ハンドル、アクセル/ブレーキペダルにも変換可能です。これらのデータを組み合わせることで、シミュレーション環境で車の運転が可能になります(図3)。

|

|

|

▲図2 Kinectプラグイン

(Depth Mapデータ) |

|

▲図3 Kinectプラグイン

(Air Driving) |

|

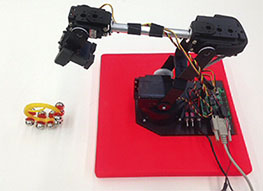

Kinectプラグインのサンプルとして、ハンドル、アクセル/ブレーキペダルの情報を使ったAir Drivingがありますが、厳しい環境でのロボットの遠隔操作用として、骨格追跡システムを調査中です。実現すると体にセンサーを付ける必要がなくなり、システムの大幅な簡素化が可能になります。弊社ではキネクトプラグインを使って小型ロボット、具体的にロボットアーム(図4)、実物の1/10サイズのラジコンカーやUAV(図5)の遠隔操作を試みました。調査では期待できる結果が出ました。

|

|

|

▲図4 ロボットの遠隔操作

(LynxMotion AL5D) |

|

▲図5 ロボットの遠隔操作

(DJI Phantom 3 Pro) |

|

Kinect for Windowsは、KinectTMの機能性をWindowsで利用できるカスタムアプリやカスタム環境を開発できます。KinectTMとUC-win/Roadを連携することで、コントロールデバイス無しでUC-win/Roadでの操作を行うことが可能となります。

街づくりの巨人

KinectTM V2にて、認識できる関節が増え、手の開閉も認識可能となり、これを活かした開発を行いました。UC-win/Roadで作成したVR空間の街に、巨人になった感覚で構造物を配置していくシステムです。

- カーソル表示:センサーで検出した距離情報から同一物体を抽出し、人間の特徴を識別。右手、左手と判断された位置にカーソル画像を表示。

- 構造物の配置(右手):配置できる構造物のアイコンにカーソルを合わせ、手を握ると構造物を掴み、配置したい位置まで右手を動かし、手を開くと構造物を配置。

- カメラ・モデルコントロール(左手):動作アイコンを用意し、アイコンにカーソルを合わせ、手を握るとカメラコントロール(回転・移動・ジャンプ)やモデルコントロール(配置のリセット・アンドゥ)を行う。

|

|

|

| ▲図6 展示会での様子 |

|

▲図7 カーソル画像の設定 |

|

| (Up&Coming '17 新年号) |

|

|

>> 製品総合カタログ

>> プレミアム会員サービス

>> ファイナンシャルサポート

|