エッジAI デバイス

HARDWARE INFORMATION

2023-No.2

HARDWARE INFORMATION

2023-No.2

今回は、エッジAIデバイスを紹介していきます。まず、AI(ArtificialIntelligence:人工知能)については、一昔前ではロボットの頭脳というイメージが強かったように思いますが、現時点においては、思考モデルに従いデータを処理・推論するシステムのことを指します。さらに、思考モデルの作成(学習)とデータの処理(推論)をどこで実行するかにより、クラウドAIとエッジAIの2つに分けることができます。

| クラウドAI | エッジAI | |

| 採用事例 | chatGPT Microsoft Edge BING(搭載予定) |

スマートフォン スマートウオッチ スマートスピーカ |

| AIのプロセス学習 …推論モデルの構築、更新 推論 …推論モデルによるデータの解析(分析・判断) |

クラウドで、学習と推論を行う。 | クラウドで学習、ローカル端末側で推論を行う。 |

| メリット | 推論モデルの構築の為の学習データを収集しやすい。 ローカル端末の処理低減。 |

リアルタイム性(低遅延) の確保。 プライバシーリスクの低減。 通信コストを削減。 |

| デメリット | リアルタイム性が低い。 プライバシーリスクが有る。 通信コストがかかる。 |

学習データによる推論モデルの構築・改良に時間がかかる。 |

たとえば、現在話題となっているChatGPTは、高度な言語解析能力を持ち、ユーザと会話が出来るAIチャットのサービスですが、これはクラウドAIに分類されます。

ネット上の膨大なデータから思考モデルを鍛え上げることで、その会話の精度が高いことが注目されています。

一方、自動運転で使用されるシステムはデバイスで処理されるため、エッジAIに分類されます。リアルタイム性が要求されるシーンではクラウドシステムへの接続による遅延は無視できないため、デバイス内で処理を行う必要が有るからです。

■ エッジAI利用例

エッジAIは、推論モデルにしたがって画像や音声などのデータを処理するデバイスです。下記のように利用されています。

1.自動車に搭載されたエッジAIはセンサーを処理して、リアルタイムで自動運転を実現します。

2.ヘルスケア

ウエアラブルデバイスには、エッジAIが搭載されており心拍数や酸素濃度などを計測することで、健康状態をリアルタイムで解析し異常を検知します。

3.製造業

製品のチェック、製造品質の安定化。

4.スマートホーム

音声認識(家電操作)や映像解析(顔認証によるセキュリティ)

■ エッジAI用デバイス

PCでもAIプログラムを設定、カメラセンサーなどと接続することで、AIシステムの構築が可能です。ただしPCではコストがかかりすぎるため、FPGAやGPUをベースとしたエッジAIデバイスが採用されることが殆どです。

FPGAの例でいうと、SUBARU レヴォーグ「アイサイトX」には、ザイリンクスのFPGA「Zynq UltraScale+ MPSoC」が採用されています※1。

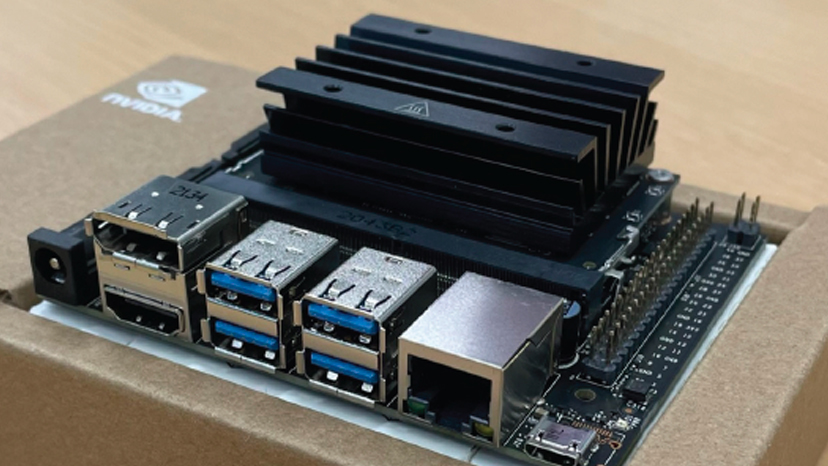

GPUの例では、NVIDIA Jetsonシリーズ※2があります。NVIDIA JetsonNanoであれば、GPIO(General Purpose Input/Output)や、カメラ入力インタフェースをサポートしているため、画像処理AIの開発用途に使うことができます。

▲NVIDIA Jetson Nano B01

■ 開発フレームワーク

AI開発に使用するツールとしてディープラーニング用フレームワークが提供されています。ここでは、代表的な2つをご紹介します。

1.TensorFlow(テンソルフロー)

Googleが開発した機械学習用のソフトウエアライブラリ。

https://www.tensorflow.org/

2.PyTorch

Pythonのオープンソース機械学習ライブラリ。Facebookが開発。

https://pytorch.org/

いずれもオープンソースソフトウエアであるため、興味のある方はAI開発にチャレンジしてみてはいかがでしょうか。

■備考

※1 Car Watch スバルの新型「アイサイトX」、心臓部にザイリンクスのFPGAを採用 新型「レヴォーグ」を支えるZynq UltraScale+ MPSoC

https://car.watch.impress.co.jp/docs/news/1270746.html

※2 NVIDIA Jetsonシリーズ

https://www.nvidia.com/ja-jp/autonomous-machines/embedded-systems/